对于我来说,一直保持的追求有三点:技术、快乐、财富。因此,从此三点出发,记录过去一周,我所看到的,值得分享的内容,每周五把欢乐送达。

技术

1、And the bit goes down

深度学习热潮席卷以来,工业界的人们一直考虑如何将深度学习算法落地到嵌入式平台。在嵌入式平台上实现高效的神经网络,不是一件容易的事情。

面对不同的应用场景,性能、功耗、成本是不得不权衡的问题。这也导致人们往往需要在模型精度和模型计算速度之间做一个权衡。

以往人们的主流选择都是MobileNets或ShuffleNets这类的高效精简框架。

现在,我们又多了一个选择。Facebook提出了一种适用于ResNet系列网络架构的压缩方法:Bit Goes Down。

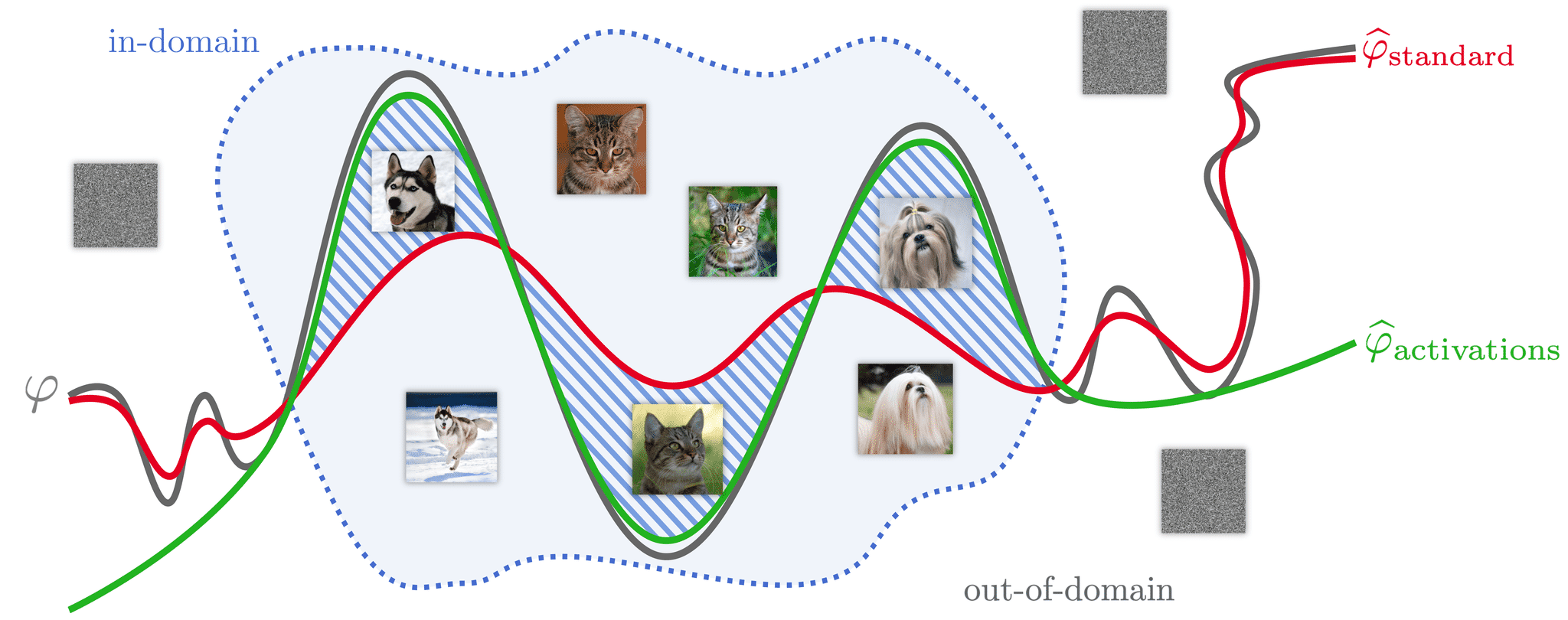

这种方法利用了结构化量化算法PQ(Product Quantization)中卷积的高相关性,重点关注activations的重建,而不是权重本身。

该算法是让未经压缩的神经网络充当“老师”,利用提炼(distillation)技术来指导“学生”网络的压缩。

这一过程无需任何标记数据,是一种无监督学习方法。

项目地址:点击查看

2、SlimYOLOv3

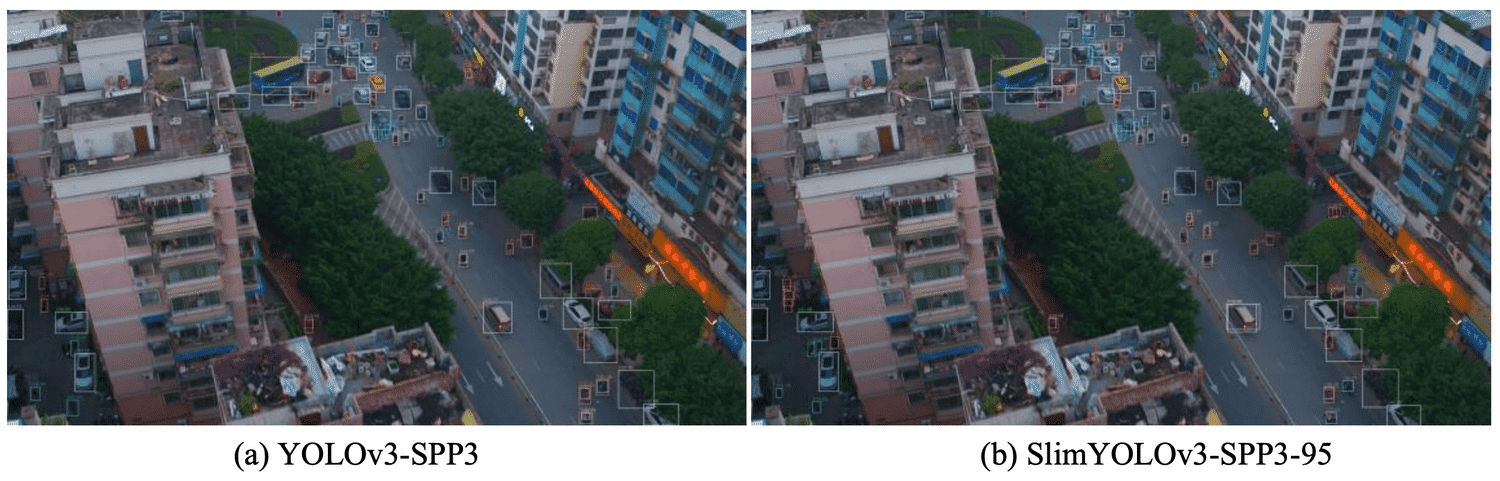

这是一个无人机目标快速检测算法,作者对YOLOv3进行了剪枝,参数量、占用内存、推断时间大幅减少的情况下,在无人机目标检测数据集上实现了与原算法可比较的检测精度。

算在在YOLOv3-SPP3基础上进行了改进,在精度稍有下降的情况下,预测时间、参数量、模型大小都减少了很多。

检测效果如下:

项目地址:点击查看

3、ERNIE 2.0

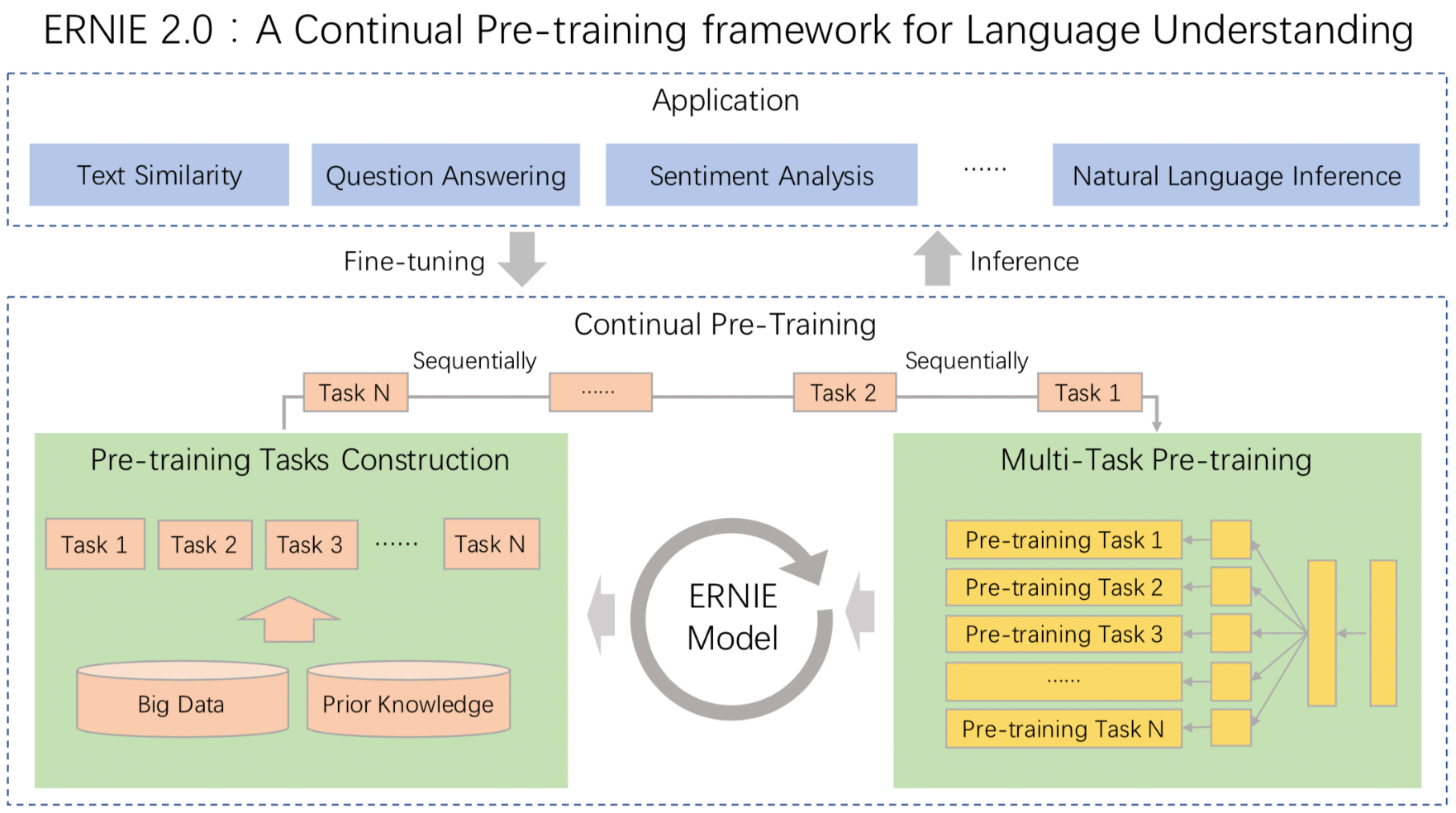

2019年3月,百度正式发布NLP模型ERNIE,其在中文任务中全面超越BERT一度引发业界广泛关注和探讨。

经过短短几个月时间,ERNIE再次升级,发布语义理解框架ERNIE 2.0,及预训练模型。

该项目使用PaddlePaddle深度学习框架,感兴趣的可以看一下。

项目地址:点击查看

4、Antialiased CNNs

大家都知道:图像主体位置变了,CNN可能就不认识这个图片了。

原因就在降采样身上。不管是最大池化,跨步卷积,还是平均池化,都对平移太敏感。

虽然,有著名的抗锯齿 (Anti-Aliasing, AA) 方法,致力解决这个问题。但把这种模块直接放进网络中,会严重影响模型的表现。

近期,Adobe的研究者让让抗锯齿和各种降采样和平共处了,在保留平移不变性的情况下,还能提升ImageNet上的分类准确率,VGG、ResNet、DenseNet等各种架构都适用。

可以看下Anti-aliased方法与Baseline的效果对比,效果提升很明显。

项目地址:点击查看

5、EXTD

这是一个人脸检测算法,与传统人脸检测算法不同的是,该算法是针对”小脸”设计的。

图片中占比很小的脸,也能使用该算法检测出来。

项目地址:点击查看

6、TOM-Net

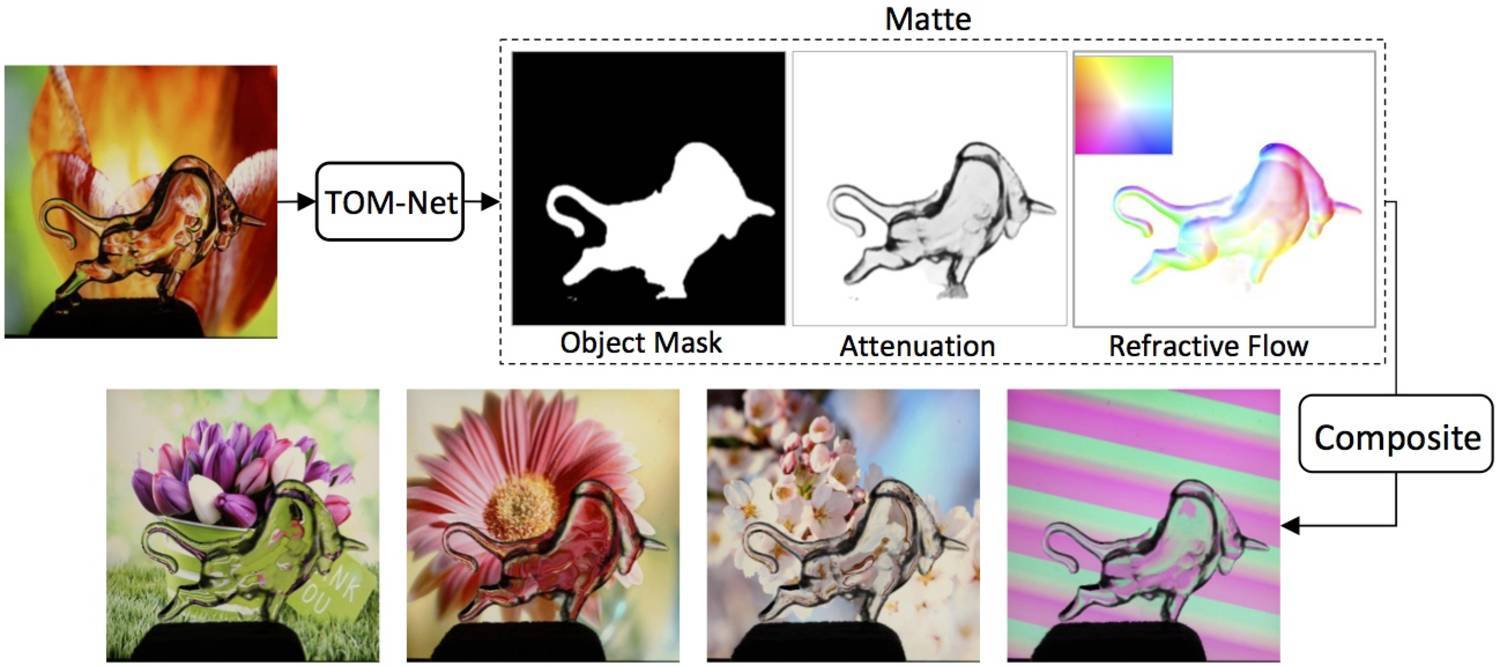

透明物体扣取算法听过吗?

TOM-Net算法是一种基于折射率流的方法处理图像中透明物体的抠取,将透明物体的抠取问题转换为了折射率流估计问题。

模型分为两部分,一部分是多尺度的编码-解码网络用于预测粗糙结果,随后利用残差模型来优化结果,模型的输出为目标的掩膜、透射率图和折射率流。

为了训练这一模型,研究人员基于COCO数据集合成了178k的透明物体数据集,同时利用14个透明物体在60个背景下采集了876张真实图像。实验结果表明这种方法可以高效快速的处理透明物体的抠取,同时也可以方便地集成到已有的抠图方法中去。

使用该算法,可以将透明材质的牛模型,扣出,方便合成到任意图片中去。

项目地址:点击查看

7、Fairseq

近期,Facebook对已开源的fairseq的PyTorch版本:fairseq-py,进行了升级。

添加了RoBERTa和wav2vec算法的代码和预训练模型,感兴趣的朋友可以看下。

Fairseq是一个序列建模工具包,允许研究人员和开发人员为翻译、总结、语言建模和其他文本生成任务训练自定义模型,它还提供了各种Seq2seq模型的参考实现。该github存储库包含有关入门、训练新模型、使用新模型和任务扩展Fairseq的说明。

项目地址:点击查看

快乐

1、电影院买的蜘蛛侠可乐杯

2、淘宝声明

财富

工作几个月,突然发现,到手工资竟然越来越少,对比发现个人所得税增加了很多。

研究一下发现,个税的税率是按照累计预扣预缴应纳所得税额计算的。

个人所得税公式:

个人所得税=(应纳税收入-减除费用-专项扣除-专项附加扣除+其他参与计税项)x预扣率-速算扣除数-特殊减免

括号里的部分,就是所说的累计预扣预缴应纳所得税额。

公式看起来挺复杂,可以分开看。

应纳税收入,就是你每月的工资。

减除费用,就是5000元个税起征点,月薪低于5000就不用纳税。

专项扣除,就是“三险一金”,包括:

- 基本医疗保险

- 失业保险

- 基本养老保险

- 住房公积金

专项附加扣除,就是专项减免政策,包括六个部分:

- 子女教育

- 继续教育

- 大病医疗

- 住房租金

- 住房贷款利息

- 赡养老人

其他参与计税项,就是那些额外所得,也需要交税的部分。

预扣费,就是上表中的,不同档,不同的扣费标准,最低是3%。

速算扣除数,也是表中的数据,不同档,数也不同。

特殊减免,是一种鼓励政策有的时候,才算的,一般都为0。

可能有些绕,具体怎么缴,举个例子。

北漂小王,身体健康,月薪20000元。无房无车,刚毕业在北京租房住,父母也没有退休。

从基本情况可以看出,专项附加扣除,只有一个住房租金,即每个月1500元免征额。

为了方便计算,“三险一金”等专项扣除,记为4300元。同时,每月减除费用5000元。

开始计算个人所得税,计算5个月的情况,看一下。

1月份:

(20000-5000-4300-1500)*3% = 276,此时累计预扣预缴应纳所得税额为20000-5000-4300-1500=9200,没有超过36000,所以预扣率为3%。

2月份:

(20000*2-5000*2-4300*2-1500*2)*3% – 276(1月份税)= 276,此时累计预扣预缴应纳所得税额为18400,没有超过36000,所以预扣率为3%。

3月份:

(20000*3-5000*3-4300*3-1500*3)*3% – 276 – 276 = 276,此时累计预扣预缴应纳所得税额为27600,没有超过36000,所以预扣率为3%。

4月份:

(20000*4-5000*4-4300*4-1500*4)*10% – 2520 – 276*3 = 332,此时累计预扣预缴应纳所得税额为36800,超过36000,没有超过144000,所以预扣率为10%。

5月份:

(20000*5-5000*5-4300*5-1500*5)*10% – 2520 – 276*3 – 332 = 920,此时累计预扣预缴应纳所得税额为46000,超过36000,没有超过144000,所以预扣率为10%。

越到年末,税越多,到手的钱也就越少。

此外,近期刚刚又有了北京市社保及公积金缴费基数调整的通知,社保及公积金基数根据个人上一年的平均月工资来核定。

这钱啊,越来越难算了。

最后

本周的程序员欢乐送,到此结束,下周再会。

来源:

https://cuijiahua.com/blog/2019/08/life-38.html